Durante a Google I/O 2015, a empresa de Mountain View anunciou o lançamento de um novo aplicativo para o armazenamento e para a organização de fotografias. Estamos falando do Google Photos, que também trouxe um sistema bem interessante de separação automática dos conteúdos que são guardados nele. E por mais que alguns duvidassem, isso realmente funciona.

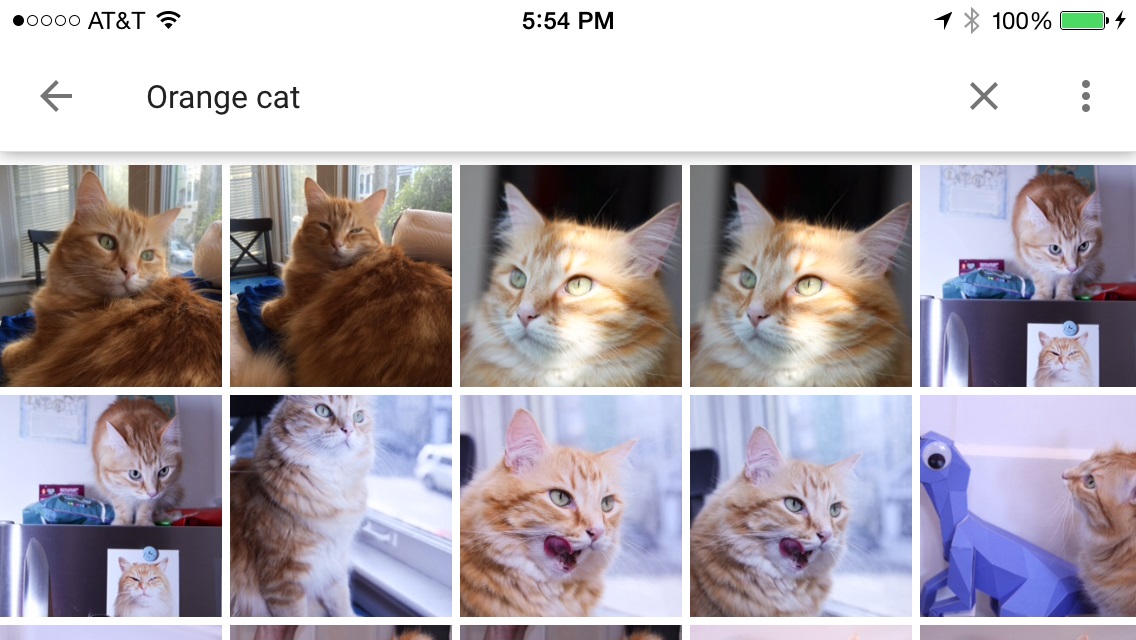

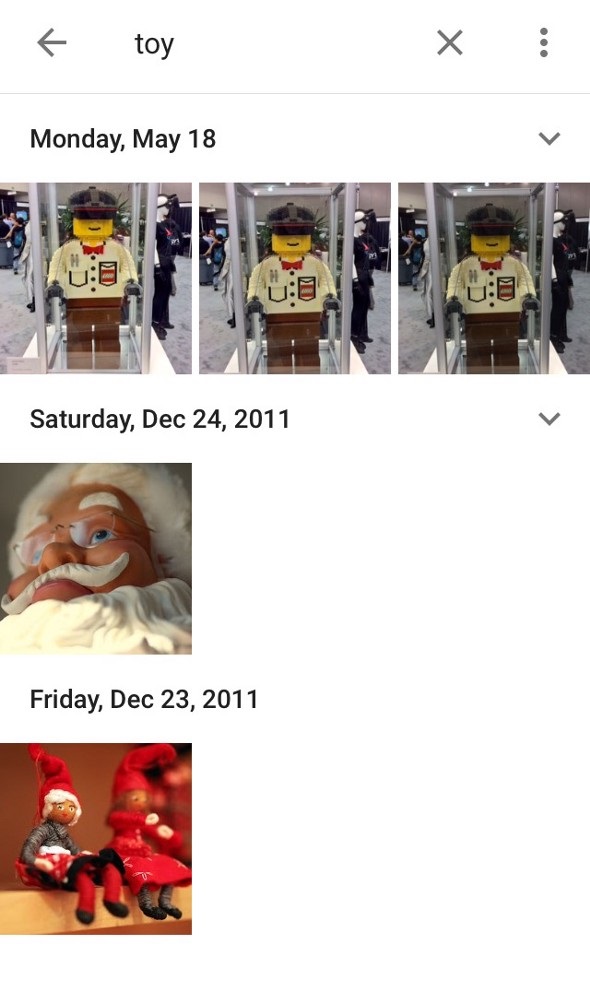

O aplicativo consegue reconhecer pessoas, objetos e animais para fazer com que a localização de documentos seja muito mais fácil. Basta digitar “cachorro”, para que todas as fotos de cachorro sejam exibidas, por exemplo. Mas qual o grande segredo para fazer com que esse sistema funcione de uma maneira tão eficiente e consiga diferenciar itens relativamente parecidos?

O grande segredo

A resposta está nas camadas. Os recursos de verificação do Google Photos fazem varreduras em 22 camadas para conseguir retornar os resultados mais eficientes para os usuários — sendo que alguns elementos mais simples são identificados em um número menor delas. Usando o mesmo exemplo que foi usado pelo BackChannel no Medium, confira a explicação:

“Se a foto é de um gato, a primeira camada analisada vai ser a das linhas e cores. Depois a isso passa para a segunda camada, em que são medidos e interpretados olhos e orelhas. Cada camada fica mais sofisticada, até que a rede consiga detectar e conectar a imagem a fatores suficientes para concluir: ‘É um gato!’. As 22 camadas são suficientes para que até mesmo uma luta de um abraço.”

É com isso que o sistema pode diferenciar um gato de um cachorro e até mesmo raças diferentes dos animais — sendo que o mesmo vale para objetos dos mais diversos tipos. Isso ainda deve melhorar com o tempo, pois o acúmulo de dados e relatórios deve dar ainda mais base para que todas as análises sejam feitas.